Cyber-Angreifer nutzen die Leistungsfähigkeit von KI, um ihre Erfolgschancen bei E-Mail-basierten Angriffen zu steigern. KI-Tools können ihnen helfen, mehr und häufigere Angriffe zu entwickeln und zu starten, und diese Angriffe evasiver, überzeugender und gezielter zu gestalten. Aber in welchem Ausmaß tun sie diese Dinge?

Es ist nicht immer einfach festzustellen, ob oder wie KI bei einem E-Mail-Angriff eingesetzt wurde, und das erschwert es, zu verstehen, was wirklich im Hintergrund passiert. Wir glauben, dass wir für den Aufbau effektiver Abwehrmaßnahmen gegen KI-basierte E-Mail-Angriffe ein besseres Verständnis dafür benötigen, wie Angreifer diese Werkzeuge heute nutzen, wofür sie sie verwenden und wie sich das entwickelt.

Es gibt zahlreiche Berichte darüber, wie Cyberkriminelle generative KI einsetzen, um ihre Gegner zu täuschen, aber es gibt nur wenige harte Daten darüber, wie Angreifer solche Werkzeuge nutzen, um die Effizienz ihrer Angriffe zu steigern.

Um einige Antworten zu finden, arbeitete eine Gruppe von Forschern der Columbia University und der University of Chicago mit Barracuda zusammen, um einen großen Datensatz unerwünschter und bösartiger E-Mails aus dem Zeitraum von Februar 2022 bis April 2025 zu analysieren.

Erkennung des Einsatzes von KI

Unser Forschungsteam hat Detektoren trainiert, um automatisch zu erkennen, ob eine bösartige oder unerwünschte E-Mail mithilfe von KI generiert wurde.

Wir haben dies erreicht, indem wir annahmen, dass E-Mails, die vor der öffentlichen Freigabe von ChatGPT im November 2022 verschickt wurden, wahrscheinlich von Menschen geschrieben wurden. So konnten wir einen zuverlässigen „False Positive“ für den Detektor ermitteln.

Das Durchlaufen des vollständigen Barracuda-Datensatzes von 2022 bis 2025 durch den Detektor zeigt einen stetigen – aber sehr unterschiedlichen – Anstieg von KI-generierten Inhalten in Spam- und Business Email Compromise (BEC)-Angriffen nach der Veröffentlichung von ChatGPT.

KI trägt dazu bei, Posteingänge mit Spam zu überfluten.

Spam zeigte den häufigsten Einsatz von KI-generierten Inhalten in Angriffen und übertraf die Verwendung in anderen Angriffsarten im letzten Jahr deutlich. Bis April 2025 wurden die meisten Spam-E-Mails (51 %) von KI statt von Menschen generiert. Die Mehrheit der E-Mails, die sich derzeit im durchschnittlichen Junk-/Spam-Ordner befinden, wurde wahrscheinlich von einem großen Sprachmodell (LLM) verfasst.

Im Vergleich dazu nimmt die Verwendung von KI-generierten Inhalten bei BEC-Angriffen deutlich langsamer zu. BEC-Angriffe erfordern Präzision: Sie zielen typischerweise auf eine leitende Person in der Organisation (z. B. den CFO) mit der Bitte um eine Überweisung oder eine Finanztransaktion. Die Analyse zeigte, dass bis April 2025 14 % der BEC-Angriffe durch KI generiert wurden.

Die Motive der Angreifer für den Einsatz von KI

Wir haben auch die Motivation der Angreifer untersucht, KI zur Erstellung von Angriffs-E-Mails einzusetzen, indem wir den Inhalt der von KI erstellten E-Mails analysiert haben.

KI-generierte E-Mails zeigten typischerweise im Vergleich zu von Menschen verfassten E-Mails einen höheren Grad an Formalität, weniger Grammatikfehler und eine größere sprachliche Raffinesse. Diese Funktionen helfen wahrscheinlich dabei, dass bösartige E-Mails Erkennungssysteme umgehen und für die Empfänger glaubwürdiger und professioneller wirken. Dies hilft in Fällen, in denen die Muttersprache der Angreifer von der ihrer Ziele abweicht. Im Barracuda-Datensatz befanden sich die meisten Empfänger in Ländern, in denen Englisch weit verbreitet gesprochen wird.

Angreifer scheinen auch KI zu verwenden, um Formulierungsvarianten zu testen, die effektiver darin sind, Abwehrmaßnahmen zu umgehen und mehr Zielpersonen dazu zu bringen, auf Links zu klicken. Dieser Prozess ähnelt dem A/B-Testing, das im traditionellen Marketing durchgeführt wird.

Beispiele für E-Mails, die als LLM-generiert erkannt wurden. Die erste ist eine BEC-E-Mail. Die zweite und die dritte sind Spam-E-Mails. Die Spam-E-Mails scheinen umformulierte Varianten zu sein, wobei die Unterschiede in Rot angezeigt werden.

Die Analyse unseres Teams zeigt, dass sich LLM-generierte E-Mails in Bezug auf das kommunizierte Gefühl der Dringlichkeit nicht signifikant von menschlich generierten E-Mails unterscheiden. Dringlichkeit ist eine bewusste Taktik, die häufig eingesetzt wird, um Druck auszuüben und eine unüberlegte Reaktion des Empfängers hervorzurufen (z. B. „Klicken Sie jetzt auf diese Schaltfläche!“, „dringende Überweisung“).

Dies deutet darauf hin, dass Angreifer hauptsächlich KI verwenden, um ihre E-Mails und möglicherweise ihr Englisch zu verfeinern, anstatt die Taktiken ihrer Angriffe zu ändern.

So schützen Sie sich vor E-Mail-Angriffen, die mit KI erstellt wurden

Die Forschung ist im Gange, da sich der Einsatz von generativer KI bei E-Mail-Angriffen weiterentwickelt und Angreifern hilft, ihre Methoden zu verfeinern und Angriffe effektiver und schwerer erkennbar zu gestalten.

Gleichzeitig helfen KI und maschinelles Lernen dabei, die Erkennungsmethoden zu verbessern. Deshalb ist eine fortschrittliche E-Mail-Sicherheitslösung, die mit einer vielschichtigen, KI/ML-gestützten Erkennung ausgestattet ist, von entscheidender Bedeutung.

Bildung bleibt auch weiterhin ein wirksamer und effektiver Schutz gegen diese Arten von Angriffen. Investieren Sie in Schulung zur Stärkung des Risikobewusstseins für Mitarbeiter, um ihnen zu helfen, die neuesten Bedrohungen zu verstehen und zu erkennen, und ermutigen Sie die Mitarbeiter, verdächtige E-Mails zu melden.

Dieses Threat Spotlight wurde von Wei Heo mit Rechercheunterstützung von Van Tran, Vincent Rideout, Zixi Wang, Anmei Dasbach-Prisk und M. H. Afifi sowie den Professoren Ethan Katz-Bassett, Grant Ho, Asaf Cidon und Junfeng Yang verfasst.

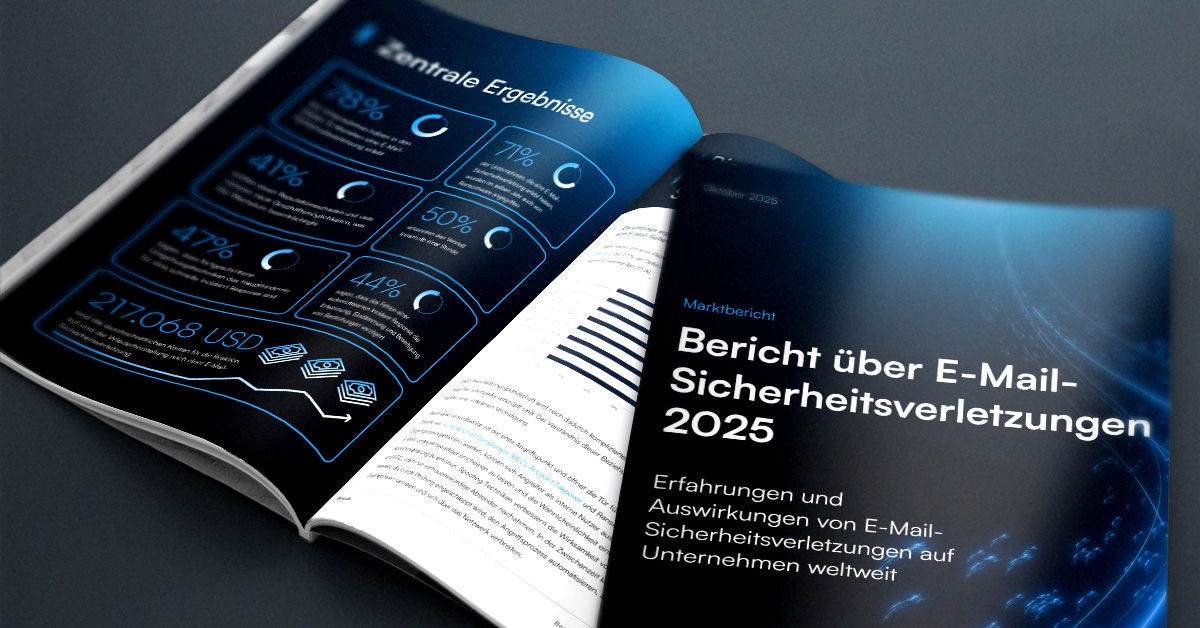

Bericht über E-Mail-Sicherheitsverletzungen 2025

Wichtige Erkenntnisse über die Erfahrungen mit und Auswirkungen von E-Mail-Sicherheitsverletzungen auf Unternehmen weltweit

Abonnieren Sie den Barracuda-Blog.

Melden Sie sich an, um aktuelle Bedrohungsinformationen, Branchenkommentare und mehr zu erhalten.

Der MSP Customer Insight Report 2025

Ein globaler Blick darauf, was Organisationen von ihren Cybersecurity Managed Service Providers benötigen und erwarten.