KI-Modelle erweisen sich als nächste große Herausforderung für die Cybersicherheit

Die Cybersecurity and Infrastructure Agency (CISA) und das National Cyber Security Centre im Vereinigten Königreich (UK) haben gemeinsam eine Reihe von Richtlinien für die sichere Entwicklung von Systemen für künstliche Intelligenz (KI) veröffentlicht, und das zu einer Zeit, in der es immer offensichtlicher wird, wie anfällig diese KI-Anwendungen sind.

Die unmittelbarste Bedrohung sind Phishing-Angriffe, durch die die Zugangsdaten von Personen, die am Training eines KI-Modells beteiligt sind, kompromittiert werden könnten. Diese Personen umfassen alle, von den Datenwissenschaftlern, die das Modell erstellen, bis hin zu Auftragnehmern, die zur Verstärkung der Schulung eingestellt wurden. Diese Angriffe zielen darauf ab, das KI-Modell zu vergiften, indem sie es ungenauen Daten aussetzen, die seine Neigung zu Halluzinationen verstärken würden, d. h. zu einer Extrapolation, die von leicht abwegig bis völlig absurd reichen kann.

Die Gelegenheit, ein KI-Modell zu vergiften, kann sich ergeben, bevor es eingesetzt wird, oder danach, wenn ein Unternehmen beispielsweise beginnt, Vektordatenbanken zu verwenden, um die Fähigkeiten eines großen Sprachmodells (LLM), das den Kern einer generativen KI-Plattform bildet, zu erweitern, indem es zusätzliche Daten einbezieht. Der Zugriff muss gesichert sein, unabhängig davon, ob ein LLM erweitert, angepasst oder von Grund auf neu erstellt wird.

Von Cybersicherheitsteams, die mit ihren Compliance-Kollegen zusammenarbeiten, wird außerdem erwartet, dass sie sicherstellen, dass keine sensiblen Daten versehentlich an eine generative KI-Plattform weitergegeben werden, die dann zu einem späteren Zeitpunkt zum Trainieren eines LLM verwendet wird.

Außerdem ist es genauso wichtig, sich daran zu erinnern, dass KI-Modelle in ihrem Kern eine andere Art von Softwareartefakt sind, das denselben Schwachstellen ausgesetzt ist, die auch andere Anwendungen betreffen. Die Malware, die Cyberkriminelle in Software-Repositorys einschleusen, kann schnell ihren Weg in ein KI-Modell finden. Das Problem ist, dass die Kosten für die Neuerstellung eines KI-Modells nach der Entdeckung um mehrere Größenordnungen teurer sind als das Patchen einer Anwendung.

Leider verfügen die Datenwissenschaftler, die KI-Modelle erstellen, über noch weniger Fachwissen im Bereich Cybersicherheit als die durchschnittlichen Anwendungsentwickler. Die Frage ist also eher, wann und in welchem Ausmaß ein Cybersicherheitsproblem die Softwarekomponenten betrifft, die für die Erstellung eines KI-Modells verwendet werden.

Natürlich werden Cybersicherheitsteams aufgefordert, sich mit Vorfällen zu befassen, an denen im Laufe der Zeit Hunderte von KI-Modellen beteiligt sein könnten. Anstatt sich ausschließlich auf LLMs zu verlassen, die über Cloud-Dienste zur Verfügung gestellt werden, setzen viele Unternehmen LLMs ein, die auf einem schmalen Datensatz trainiert wurden, um Prozesse zu automatisieren, die für bestimmte Wissensbereiche spezifisch sind.

Die gute Nachricht ist, dass Cybersicherheitsexperten, die verstehen, was für sichere KI-Modelle erforderlich ist, bereits hohe Nachfrage haben. Das Gehaltsniveau, das diese Cybersicherheitsexperten erzielen können, kann dadurch deutlich höher ausfallen.

Die Herausforderung wird wie immer darin bestehen, alle an diesen Projekten Beteiligten für die Bedeutung der Sicherheit zu sensibilisieren. Es besteht immer die Tendenz, Innovationen überstürzt auf den Markt zu bringen, aber Eile führt oft zu nichts. Im Fall von KI-Anwendungen, die Prozesse in noch nie dagewesenem Umfang automatisieren, hat ein Cybersicherheitsproblem mehr denn je das Potenzial, katastrophale Folgen zu haben.

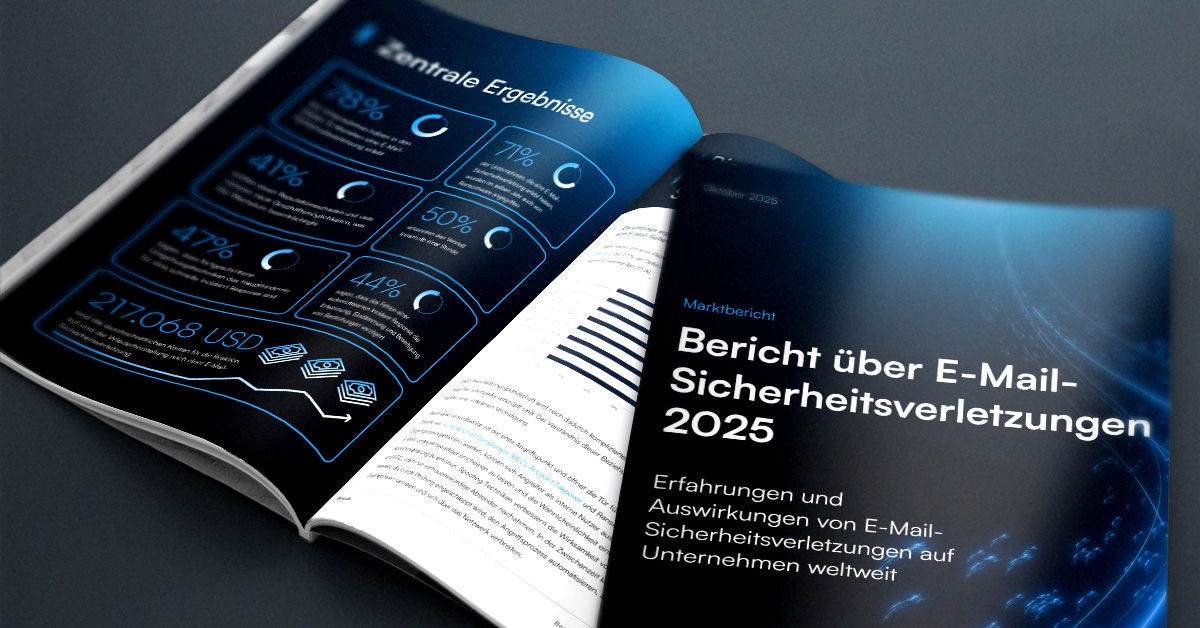

Bericht über E-Mail-Sicherheitsverletzungen 2025

Wichtige Erkenntnisse über die Erfahrungen mit und Auswirkungen von E-Mail-Sicherheitsverletzungen auf Unternehmen weltweit

Abonnieren Sie den Barracuda-Blog.

Melden Sie sich an, um aktuelle Bedrohungsinformationen, Branchenkommentare und mehr zu erhalten.

Der MSP Customer Insight Report 2025

Ein globaler Blick darauf, was Organisationen von ihren Cybersecurity Managed Service Providers benötigen und erwarten.